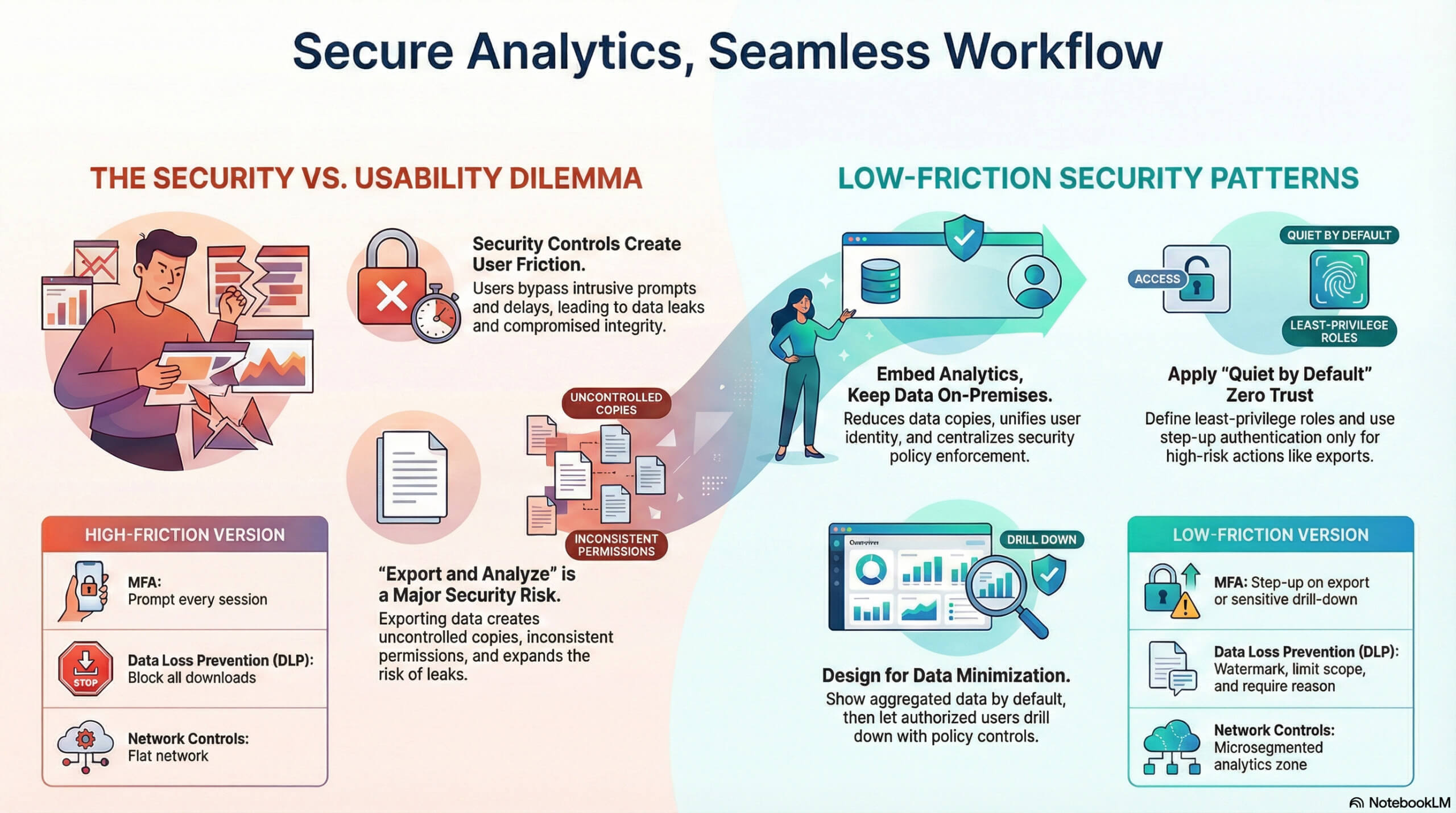

A volte i dirigenti sembrano volere due cose allo stesso tempo. Risposte rapide all'interno degli strumenti operativi e un controllo rigoroso sui dati sensibili nell'analisi aziendale (business analytics). Il problema è l'attrito. Molti controlli di sicurezza aggiungono prompt, ritardi e schermate bloccate. Gli utenti li aggirano o sviluppano una "memoria muscolare" in cui fanno clic su un pulsante senza cogliere appieno il significato del testo che vedono, o che non hanno visto consapevolmente. Se ci pensi bene, ti suona familiare? Gli analisti esportano su fogli di calcolo; spesso è ancora la loro arma preferita. I leader possono perdere la fiducia nei numeri quando la storia che raccontano non si basa su fatti credibili. Peggio ancora se quei fatti sono inquinati o compromessi.

La sicurezza è molto più che prevenire le fughe di dati e fare in modo che non finiscano nelle mani sbagliate; riguarda anche la garanzia dell'integrità dei dati forniti, le verità su cui si basano la tua storia di BI e le tue analisi. Ma garantire questa certezza dei dati fattuali non dovrebbe interferire indebitamente con il loro consumo e utilizzo rendendo i metodi di sicurezza impiegati troppo onerosi: è questa la parte difficile, l'equilibrio e l'efficacia.

La soluzione non è "meno sicurezza". È una sicurezza che si adatta alle intenzioni dell'utente e al rischio, con controlli che rimangono in background per la maggior parte del tempo. L'hosting on-premise è d'aiuto perché mantiene i set di dati critici, le chiavi e l'applicazione delle policy vicino ai sistemi di registrazione (systems of record). Riduce inoltre l'esposizione dei dati a terze parti e il raggio d'impatto (blast radius) del fornitore. Quando l'equilibrio è giusto, la sicurezza è endemica, efficace, pervasiva, ma virtualmente impercettibile.

Una domanda conta più delle altre: come possono le analisi rimanere all'interno del flusso di lavoro dell'utente mantenendo al contempo una sicurezza rigorosa?

Mantieni le analisi nel prodotto, i dati on-premise

L'analisi integrata (embedded) batte "esporta e analizza"

Il flusso dell'utente si interrompe quando le analisi risiedono in una destinazione separata. Il cambio di strumenti aggiunge prompt di accesso, autorizzazioni diverse, filtri diversi e ulteriori esportazioni. Le esportazioni creano copie e le copie creano fughe di dati.

Un modello più sicuro è l'analisi integrata (embedded analytics) all'interno della stessa applicazione in cui lavorano gli utenti. Ciò offre tre vantaggi concreti per i dati sensibili nell'analisi aziendale:

- Meno copie di dati. Il calcolo avviene vicino alla fonte e i risultati fluiscono verso l'interfaccia utente (UI).

- Identità coerente. La stessa identità utente controlla le azioni e le analisi.

- Applicazione delle policy in un unico posto. Le regole di sicurezza si applicano sia alle transazioni che alle query.

L'hosting on-premise limita anche ciò che un fornitore di analisi di terze parti può vedere. L'accesso del fornitore diventa un'eccezione, non la regola. Questo è importante perché il rischio legato alla catena di fornitura e a terze parti è un tema ricorrente nelle linee guida informatiche, comprese le previsioni per il 2026 pubblicate da Morrison Foerster.

Obiettivo di progettazione: controlli invisibili, responsabilità visibile

I team di sicurezza misurano spesso la forza del controllo che hanno sulle minacce. Gli utenti misurano le interruzioni dei risultati desiderati o le frustrazioni nel raggiungere i propri obiettivi. L'obiettivo giusto è "silenzioso per impostazione predefinita" (quiet by default), con prove evidenti quando qualcosa va, o è andato, storto. Non è sufficiente avere la "sensazione" che qualcosa non vada bene.

Ciò corrisponde al passaggio verso controlli dei dati adattivi e basati su policy descritti nella discussione sulle tendenze del 2026 della protezione e automazione unificata dei dati di Cyberhaven.

Dati sensibili nell'analisi aziendale: Zero Trust senza prompt costanti

Verifica continua, privilegio minimo (least privilege), microsegmentazione

Lo Zero Trust è adatto per l'analisi perché l'accesso alle query è un percorso ad alto rischio. Un singolo analista può estrarre milioni di righe più velocemente di qualsiasi schermata di app. In parole povere, la capacità di accedere ai dati grezzi in modo completo comporta un'espansione dei potenziali usi impropri di tali dati, nonché un rischio per la loro veridicità se viene concessa una capacità illimitata di modificarli senza il giusto livello di supervisione.

Applica lo Zero Trust in modi che non interrompano il flusso:

- Ruoli di query con privilegi minimi. Definisci i ruoli in base all'attività, non alla qualifica. Separa "visualizza schede KPI" da "esporta dettagli a livello di riga".

- Microsegmentazione per i servizi di analisi. Isola il motore di query dalle reti operative. Limita il traffico est-ovest.

- Autenticazione rafforzata (step-up) basata sul rischio solo quando necessario. Non aggiungere prompt MFA a ogni visualizzazione del grafico. Attiva lo step-up durante l'esportazione, l'ampliamento degli intervalli di selezione o l'accesso a campi regolamentati.

Ciò è in linea con le comuni linee guida Zero Trust, tra cui la verifica dell'identità, il privilegio minimo e la segmentazione descritti negli approfondimenti Zero Trust di Archtis.

Modello UX: divulgazione progressiva dei dettagli sensibili

La maggior parte degli utenti non ha bisogno di identificatori grezzi. Fornisci loro aggregati per impostazione predefinita, quindi consenti agli utenti autorizzati di effettuare il drill-down. Il drill-down diventa il "punto di controllo" per l'autorizzazione step-up, la richiesta di commenti di giustificazione o una concessione di accesso limitata nel tempo.

Ciò aiuta a mantenere veloci le dashboard e riduce l'esposizione sensibile durante il normale lavoro.

Minimizzazione dei dati che supporta comunque le decisioni

Riduci la superficie di esposizione fin dalla progettazione (by design)

La minimizzazione dei dati non è uno slogan. È una specifica di progettazione.

Per i dati sensibili nell'analisi aziendale, la minimizzazione si presenta così:

- Modellazione basata prima sulle metriche (Metric-first). Pre-calcola le metriche aziendali da fonti sensibili, memorizza solo i valori derivati ove possibile.

- Predefinito a coorti e intervalli. Mostra fasce, percentili e conteggi, quindi consenti il drill-down con controlli.

- Breve conservazione per i risultati delle query. Memorizza nella cache gli aggregati per la velocità, ma falli scadere rapidamente e crittografa i dati memorizzati nella cache.

Ciò corrisponde ai principi di base della sicurezza dei dati come la limitazione della raccolta e la restrizione dell'accesso, come riassunto nelle best practice per la sicurezza dei dati di Palo Alto Networks e anche in panoramiche come il manuale sulla sicurezza dei dati di Coursera.

Tabella: scelte di minimizzazione che proteggono il flusso

| Scelta di progettazione | Cosa vedono gli utenti | Vantaggio per la sicurezza | Vantaggio per l'UX |

| Dashboard orientate agli aggregati | KPI, tendenze, avvisi | Meno esposizione ai dati grezzi | Caricamento più rapido, meno filtri |

| Campi sensibili mascherati per impostazione predefinita | Identificatori parziali | Riduce il rischio interno (insider risk) | Meno avvisi spaventosi |

| Drill-down limitato dalle policy | Dettagli solo quando necessario | Forte punto di controllo | I prompt avvengono raramente |

| Esportazioni vincolate allo scopo | Esportazione con motivo, ambito | Migliore traccia di controllo (audit trail) | Intento dell'utente più chiaro |

Dati sensibili nell'analisi aziendale: Classificazione in tempo reale e instradamento basato sulla sensibilità

Classifica una volta, applica ovunque

La classificazione fallisce quando dipende da tag manuali. Le pipeline di analisi acquisiscono dati da molti sistemi e la sensibilità cambia con i join. La classificazione in tempo reale e i controlli delle policy riducono gli errori.

Un modello on-premise pratico:

- Classifica i campi al momento dell'inserimento. Tagga le colonne come pubbliche, interne, riservate, regolamentate.

- Collega i tag alla derivazione (lineage). Quando i set di dati si combinano, la sensibilità dovrebbe seguire.

- Instrada in base alla sensibilità. I dati regolamentati rimangono in archivi a controllo elevato e pool di elaborazione a controllo elevato.

- Esegui il rendering in base alla sensibilità. L'interfaccia utente (UI) utilizza gli stessi tag per decidere cosa può vedere un ruolo.

Ciò supporta il passaggio verso una protezione unificata e automatizzata e cicli di applicazione rapidi discussi nelle tendenze del 2026 di Cyberhaven.

Modello UX: "impostazioni predefinite sicure" con eccezioni rapide

Gli utenti non dovrebbero scegliere i livelli di sensibilità. Dovrebbe farlo il prodotto. Quando sono necessarie eccezioni, usa un flusso rigoroso: una piccola casella di giustificazione, una concessione di breve durata e una registrazione (logging) visibile.

Valutazione continua dell'esposizione per le superfici di analisi

Testa i percorsi dei dati, non solo gli host

L'analisi, in particolare l'analisi di terze parti, crea nuove superfici di attacco: API di query, livelli semantici, archivi di risultati memorizzati nella cache, endpoint di esportazione e token di incorporamento (embed tokens). La valutazione dell'esposizione deve concentrarsi lì.

L'analisi integrata, ovviamente, fornisce una superficie di esposizione molto più piccola rispetto a soluzioni esterne di terze parti. Yellowfin implementa un rigoroso modello di sicurezza per proteggere i tuoi dati aziendali da più angolazioni, incluso l'accesso basato sui ruoli e la crittografia a riposo e in transito.

Passaggi pratici:

- Scansiona le API di analisi per individuare eventuali autorizzazioni a livello di oggetto non funzionanti.

- Testa i token di incorporamento per rilevare abusi di replay e di ambito (scope).

- Verifica che le cache non memorizzino campi regolamentati in chiaro (plaintext).

- Convalida la sicurezza a livello di riga e colonna durante i join.

Tabella: controlli di analisi comuni e la loro forma a "basso attrito"

| Controllo | Versione ad alto attrito | Versione a basso attrito |

| MFA | Prompt in ogni sessione | Step-up sull'esportazione o sul drill-down sensibile |

| DLP | Blocca tutti i download | Filigrana, limita l'ambito, registra, richiedi il motivo |

| Controlli di rete | Rete piatta | Zona di analisi microsegmentata |

| Registrazione (Logging) | Audit manuali | Acquisizione automatica delle prove nelle dashboard di conformità |

Crittografia e pianificazione post-quantistica senza sorprese di latenza

Crittografa i dati a riposo, in transito e nella cache

On-premise non significa "sicuro per la posizione". Significa che controlli le chiavi, le reti e le policy. Crittografa:

- A riposo in data warehouse, lakehouse e archivi semantici.

- In transito per il traffico delle query e le connessioni di incorporamento.

- Nelle cache dove i team addetti alle prestazioni spesso tagliano gli angoli.

Le linee guida principali indicano costantemente la crittografia e i protocolli robusti come controlli fondamentali, incluso il riepilogo delle best practice di Palo Alto Networks.

Per i dati sensibili a lunga conservazione nell'analisi aziendale, inizia a pianificare la preparazione post-quantistica. Trattalo come un elemento della roadmap legato ai periodi di conservazione dei dati e alla rotazione delle chiavi, non come una ricostruzione improvvisa. Le discussioni strategiche per il 2026 spesso affiancano la pianificazione post-quantistica a programmi di protezione più ampi, incluse le linee guida orientate alla pianificazione nelle strategie di protezione dei dati per il 2026 di Hyperproof.

Analisi comportamentale che rileva l'uso improprio senza bloccare il lavoro reale

Dati di base (baseline) per ruolo, non per utente

Gli analisti esplorano. È il loro lavoro. Quindi il rilevamento delle anomalie deve comprendere i modelli dei ruoli.

Segnali positivi:

- Passaggio improvviso dagli aggregati agli identificatori grezzi.

- Query che abbracciano unità aziendali insolite.

- Paginazione rapida o loop di esportazione.

- Nuovi strumenti o client che colpiscono l'API di query.

Quindi applica risposte che mantengano intatto il flusso:

- Avvisi leggeri (soft warnings) all'interno del prodotto.

- Ri-autenticazione just-in-time per azioni sensibili.

- Limiti di frequenza (rate limits) sulle esportazioni, non sui grafici.

Ciò corrisponde alla spinta del settore verso controlli sensibili al contesto e decisioni adattive discussi in diverse rassegne sulle tendenze della sicurezza per il 2026, tra cui Cyberhaven e l'inquadramento delle tendenze più ampie del Tarian Group.

Conformità pronta per l'audit che non crea lavoro manuale

Rendi le prove automatiche

Il lavoro di conformità può spesso interrompere il flusso sia per gli utenti che per gli ingegneri. La soluzione è l'acquisizione automatica delle prove:

- Registra ogni accesso a un campo sensibile con utente, ruolo, dispositivo e scopo.

- Memorizza le impronte digitali (fingerprints) delle query, non il testo completo della query, nel caso in cui il testo possa includere valori letterali.

- Registra le decisioni di policy, inclusi i rifiuti e i trigger di step-up.

Ciò supporta "l'audit per query" anziché "l'audit per foglio di calcolo". L'automazione della conformità è un tema ricorrente nelle linee guida sulla sicurezza incentrate sulla governance, incluso l'approccio strutturato ai controlli descritto in Hyperproof.

Rischio dei fornitori e di terze parti quando i dati rimangono on-premise

Tratta l'accesso dei fornitori come un flusso di lavoro controllato e registrato

I fornitori di analisi di terze parti spesso chiedono estratti di dati o connettori diretti. Ciò crea nuove copie, nuove credenziali e nuove esposizioni legali.

Se i dati sensibili nell'analisi aziendale devono rimanere on-premise:

- Preferisci analisi integrate che vengono eseguite all'interno del tuo perimetro.

- Se un fornitore deve connettersi, limitalo a una zona di rete segmentata.

- Utilizza credenziali di breve durata e account di servizio con ambito limitato (scoped).

- Rivedi gli ambiti delle API e ruota le chiavi con una pianificazione fissa.

Le aspettative normative e sulle infrastrutture critiche puntano sempre più a una governance più forte e al controllo dei fornitori, come rilevato nelle previsioni sulla privacy e informatica per il 2026 di Morrison Foerster.

Una pratica lista di controllo per la creazione di analisi che rimangono nel flusso

Utilizzala come passaggio di implementazione per le analisi on-premise che servono dati sensibili:

- Metti l'analisi all'interno dell'interfaccia utente del prodotto operativo.

- Usa per impostazione predefinita gli aggregati, proteggi i dettagli con le policy.

- Applica la sicurezza a livello di riga e colonna nel livello della query.

- Classifica i dati al momento dell'inserimento, mantieni i tag lungo la derivazione (lineage).

- Crittografa l'archiviazione, il transito e le cache. Controlla le chiavi in loco (on-premise).

- Aggiungi l'autenticazione step-up solo per azioni rischiose, come l'esportazione.

- Esegui test di esposizione continui sulle API di query e sui percorsi di incorporamento.

- Registra automaticamente le decisioni relative alle policy e gli eventi di accesso sensibili.

- Tratta l'accesso al fornitore come raro, delimitato e completamente registrato.

L'hosting on-premise non è nostalgia. È una scelta di controllo. Se combinato con l'analisi integrata e modelli di sicurezza a basso attrito, consente ai team di fornire insight rapidi senza trasformare i dati sensibili nell'analisi aziendale in un costante compromesso in termini di rischio.

FAQ (Domande Frequenti)

In che modo i principi Zero Trust si applicano specificamente all'autorizzazione delle query di analisi senza bloccare le analisi legittime?

Applica ruoli di query con privilegi minimi in base all'attività, isola il livello di analisi/query tramite la microsegmentazione e utilizza l'autenticazione rafforzata (step-up) basata sul rischio solo per azioni a rischio più elevato (esportazioni, ambiti più ampi, campi regolamentati), non per la visualizzazione di routine della dashboard.

Quali requisiti normativi (GDPR, HIPAA, SOX) influiscono più direttamente sulla gestione dei dati di analisi on-premise?

In pratica, questi spingono più direttamente verso: rigorosi controlli di accesso (a livello di riga/colonna ove necessario), crittografia a riposo/in transito/in cache, visualizzazioni ridotte/aggregate per impostazione predefinita, esportazioni controllate e acquisizione di prove pronte per l'audit di accessi sensibili e decisioni di policy.

In che modo le organizzazioni possono convalidare che la crittografia e i controlli di accesso stiano effettivamente proteggendo i dati analitici sensibili?

Testa continuamente i percorsi specifici dell'analisi: scansiona le API delle query per individuare errori di autorizzazione, convalida la sicurezza di righe/colonne nei join, verifica che le cache non memorizzino i campi regolamentati in chiaro (plaintext) e testa i token di incorporamento per abusi di replay/ambito. Quindi corrobora con la registrazione automatizzata (logging) dell'accesso ai campi sensibili e delle decisioni sulle policy.

Qual è la differenza tra impedire l'esposizione dei dati e impedire flussi di lavoro analitici legittimi?

Prevenire l'esposizione significa utilizzare per impostazione predefinita visualizzazioni sicure (aggregati, campi mascherati) e controllare il drill-down/esportazioni sensibili; prevenire i flussi di lavoro è un blocco generalizzato che costringe gli utenti a soluzioni alternative (come le esportazioni).

In che modo il rilevamento delle anomalie comportamentali può distinguere tra un analista di dati che scopre insight e una minaccia interna (insider threat) che esfiltra dati?

Stabilisci il comportamento previsto (baseline) per ruolo, quindi segnala i cambiamenti come il passaggio dagli aggregati agli identificatori grezzi, l'ambito di unità aziendali insolito, la rapida impaginazione/cicli di esportazione o nuovi client che interrogano le API. Rispondi con controlli a basso attrito (avvisi leggeri, riautenticazione just-in-time, limiti di frequenza di esportazione).

Quale impatto sulla latenza o sulle prestazioni delle query dovrebbero aspettarsi le organizzazioni dall'aggiunta di controlli di sicurezza ai sistemi di analisi?

Se i controlli sono "silenziosi per impostazione predefinita", il normale utilizzo della dashboard rimane rapido (caching degli aggregati, prompt minimi), mentre un ulteriore attrito è riservato ad azioni a rischio più elevato come drill-down sensibili ed esportazioni (autenticazione step-up, limiti con ambito, registrazione).

L'elaborazione dell'analisi dovrebbe avvenire su un'infrastruttura on-premise dedicata, isolata dai sistemi operativi?

Sì, tratta l'analisi come una zona segmentata: isola il motore di query dalle reti operative, limita il traffico est-ovest e instrada i dati regolamentati verso pool di elaborazione a controllo più elevato.

In che modo le strategie di minimizzazione dei dati entrano in conflitto con la necessità di set di dati di analisi completi?

Entrano in conflitto quando la minimizzazione rimuove il contesto necessario; risolvi il problema progettando modelli orientati in primo luogo agli aggregati (basati sulle metriche, coorti/intervalli) e consentendo il drill-down controllato solo quando giustificato e autorizzato.

Quale ruolo dovrebbero avere i fornitori di analisi di terze parti nelle organizzazioni che utilizzano solo dati on-premise?

L'accesso al fornitore dovrebbe essere l'eccezione: preferisci l'analisi integrata all'interno del tuo perimetro; se un fornitore deve connettersi, limitalo a una zona segmentata con credenziali di breve durata e limitate, rigorosa revisione dell'ambito delle API/rotazione delle chiavi e registrazione completa.

In che modo le organizzazioni misurano se la sicurezza delle loro analisi è proporzionata all'effettivo rischio aziendale?

Allinea i controlli all'intento e al rischio (step-up solo per azioni rischiose), convalida i punti di esposizione reali (API/token/cache/join) e garantisci la "responsabilità visibile" tramite l'acquisizione automatica delle prove anziché un attrito costante per l'utente.

Qual è la relazione tra l'accuratezza della classificazione dei dati e l'effettivo controllo dell'accesso all'analisi?

La classificazione è la base: contrassegna (tag) i campi al momento dell'inserimento, trasmetti la sensibilità attraverso derivazioni (lineage)/join e usa quei tag per instradare l'elaborazione e renderizzare ciò che ogni ruolo può vedere. Tag errati significano un'applicazione non corretta.

In che modo le organizzazioni possono prevedere e prevenire l'esposizione dei dati correlata all'analisi prima che si verifichino incidenti?

Combina la valutazione continua dell'esposizione (testa le API di query, i token, le cache e il comportamento dei join) con il rilevamento delle anomalie basato sui ruoli e le prove di audit automatiche, in modo che i problemi vengano portati alla luce tempestivamente senza interrompere l'analisi legittima.```