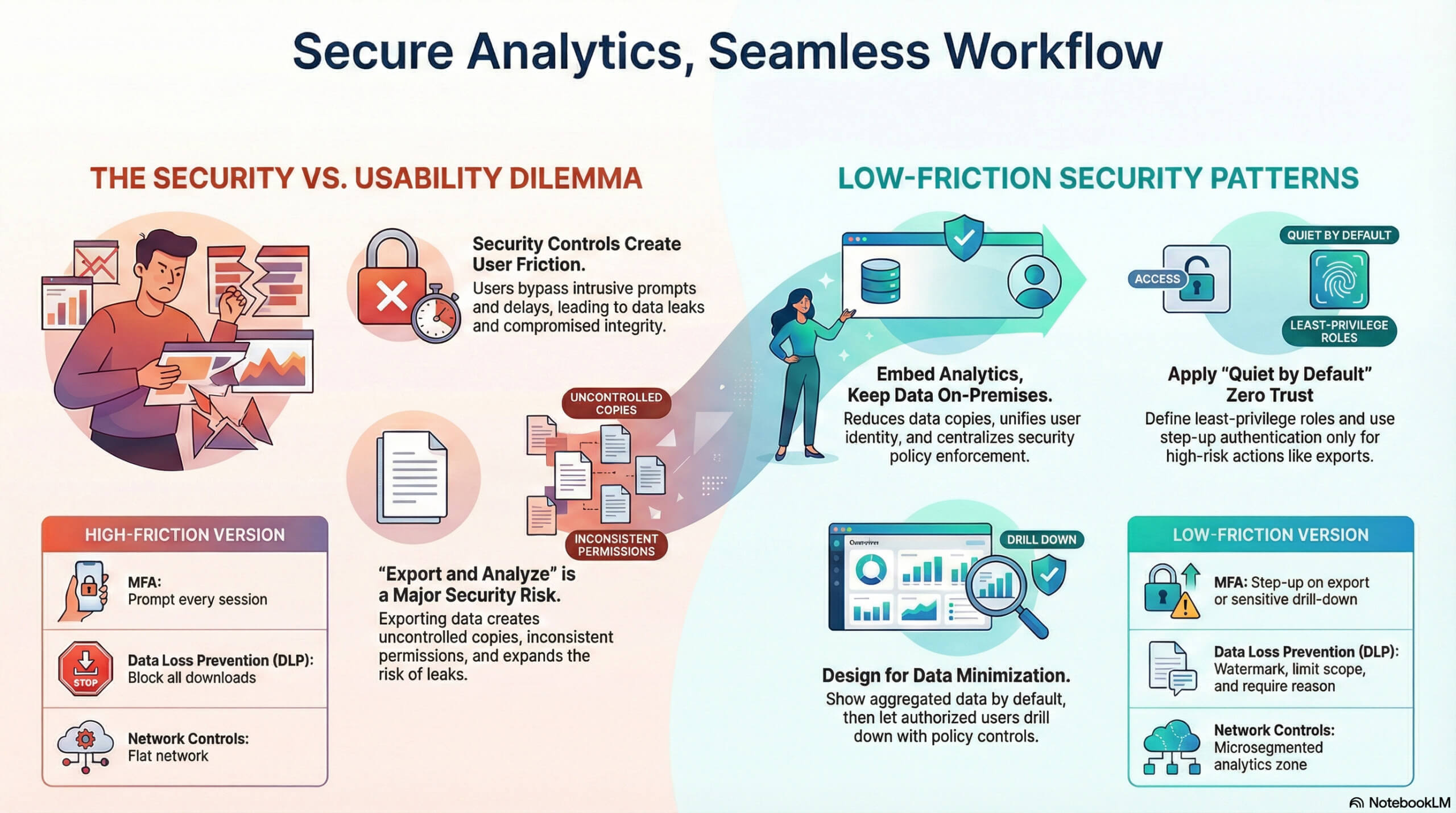

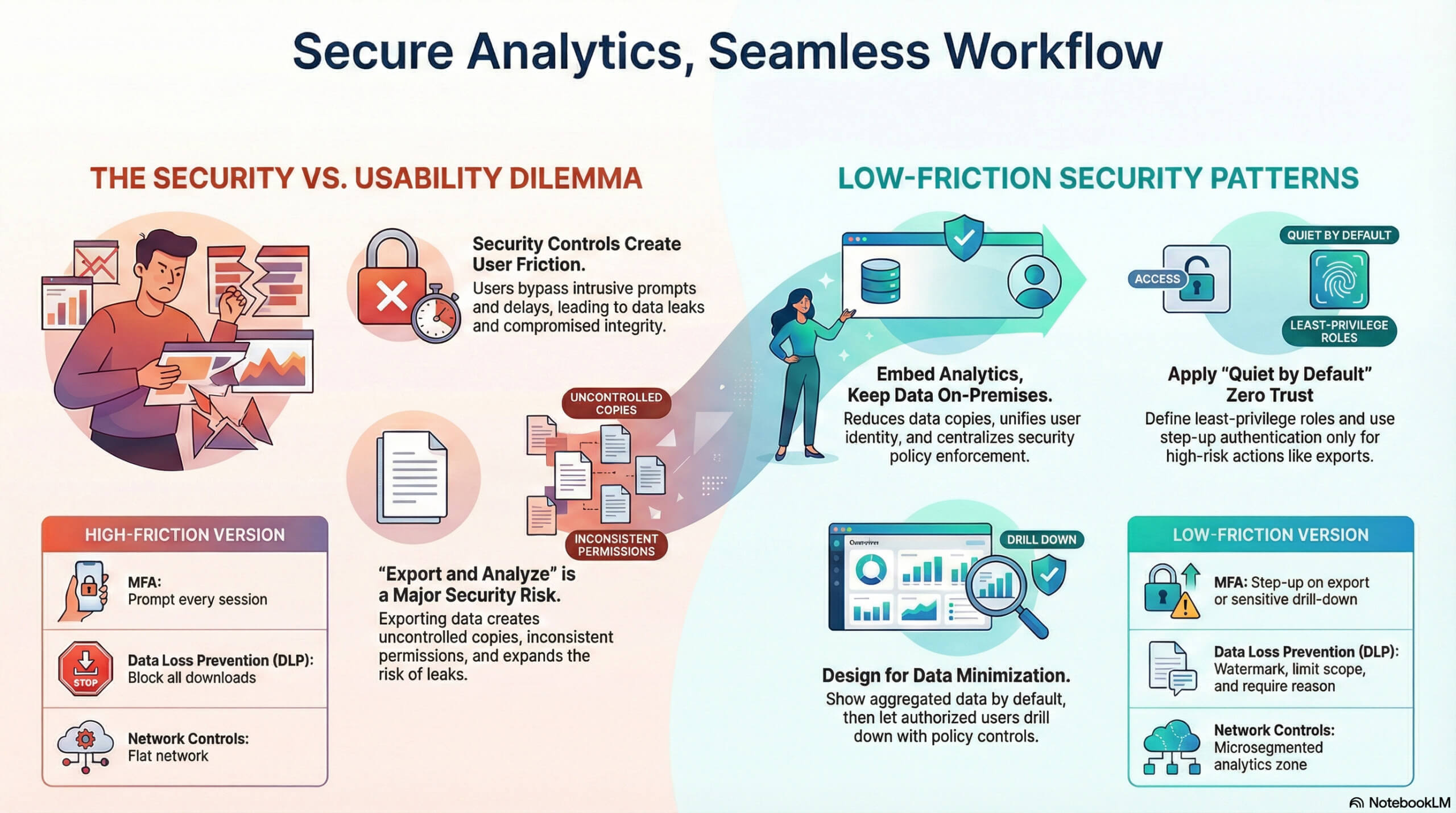

Os executivos parecem, por vezes, querer duas coisas ao mesmo tempo. Respostas rápidas dentro de ferramentas operacionais e um controlo rigoroso sobre dados sensíveis na análise de negócios (business analytics). O problema é o atrito. Muitos controlos de segurança adicionam pedidos (prompts), atrasos e ecrãs bloqueados. Os utilizadores contornam-nos ou desenvolvem uma "memória muscular" em que clicam num botão sem absorverem totalmente o significado do texto que veem - ou que nem sequer viram conscientemente. Se pensar bem, isto parece-lhe familiar? Os analistas exportam para folhas de cálculo; muitas vezes ainda é a sua arma de eleição. Os líderes podem perder a confiança nos números quando a história que contam não se apoia em factos credíveis. Pior ainda se esses factos estiverem poluídos ou comprometidos.

A segurança é muito mais do que apenas prevenir fugas de dados e evitar que caiam nas mãos erradas; trata-se também de garantir a integridade dos dados fornecidos, as verdades sobre as quais a sua história de BI e as suas análises são construídas. Mas garantir essa certeza dos dados factuais não deve interferir indevidamente com o seu consumo e utilização, tornando os métodos de segurança empregues demasiado onerosos - e essa é a parte difícil, o equilíbrio e a eficácia.

A solução não é "menos segurança". É uma segurança que corresponda à intenção do utilizador e ao risco, com controlos que funcionem em segundo plano na maior parte do tempo. O alojamento on-premises ajuda porque mantém os conjuntos de dados críticos, as chaves e a aplicação de políticas perto dos sistemas de registo (systems of record). Também reduz a exposição de dados a terceiros e o raio de impacto (blast radius) do fornecedor. Quando o equilíbrio é o correto, a segurança é endémica, eficaz, abrangente, mas virtualmente impercetível.

Há uma pergunta que importa mais do que as outras: como podem as análises permanecer dentro do fluxo de trabalho do utilizador enquanto a segurança se mantém rigorosa?

Conteúdo do blogue

Espetáculo

Manter as Análises no Produto, os Dados On-Premises

A análise integrada (embedded) supera a opção de "exportar e analisar"

O fluxo do utilizador é interrompido quando as análises residem num destino separado. A mudança de ferramentas acrescenta pedidos de início de sessão, permissões diferentes, filtros diferentes e mais exportações. As exportações criam cópias, e as cópias criam fugas. Um padrão mais seguro é a análise integrada (embedded analytics) dentro da mesma aplicação em que os utilizadores trabalham. Isso oferece três benefícios concretos para dados sensíveis na análise de negócios:- Menos cópias de dados. O processamento ocorre perto da origem e os resultados fluem para a interface de utilizador (UI).

- Identidade consistente. A mesma identidade de utilizador controla as ações e as análises.

- Aplicação de políticas num só local. As regras de segurança aplicam-se tanto a transações como a consultas (queries).

Objetivo de conceção: controlos invisíveis, responsabilidade visível

As equipas de segurança medem frequentemente a força do controlo que têm sobre as ameaças. Os utilizadores medem as interrupções aos seus resultados desejados ou as frustrações em atingir os seus objetivos. O alvo certo é "silencioso por defeito" (quiet by default), com provas fortes quando algo corre, ou correu, mal. Não basta ter um "pressentimento" de que algo não está bem. Isso corresponde à mudança para controlos de dados adaptativos e baseados em políticas, descritos na discussão das tendências de 2026 sobre proteção unificada de dados e automação da Cyberhaven.Dados Sensíveis na Análise de Negócios: Zero Trust sem Pedidos Constantes

Verificação contínua, privilégio mínimo (least privilege), microsegmentação

O Zero Trust adequa-se à análise porque o acesso por consulta (query) é uma via de alto risco. Um único analista pode extrair milhões de linhas mais rapidamente do que qualquer ecrã de aplicação. Em termos simples, a capacidade de aceder a dados brutos de forma abrangente significa uma expansão de potenciais usos indevidos desses dados, bem como um risco para a sua veracidade se for concedida uma capacidade ilimitada para os alterar sem o nível de supervisão adequado. Aplique o Zero Trust de formas que não quebrem o fluxo:- Funções de consulta de privilégio mínimo. Defina as funções por tarefa e não por cargo. Separe a "visualização de cartões KPI" da "exportação de detalhes ao nível da linha".

- Microsegmentação para serviços de análise. Isole o motor de consultas das redes operacionais. Restrinja o tráfego este-oeste.

- Autenticação reforçada (step-up) baseada no risco apenas quando necessário. Não adicione pedidos de MFA a cada visualização de gráfico. Acione o reforço (step-up) ao exportar, ao alargar os intervalos de seleção ou ao aceder a campos regulamentados.

Padrão UX: divulgação progressiva de detalhes sensíveis

A maioria dos utilizadores não precisa de identificadores brutos. Dê-lhes agregados por defeito, e depois permita que os utilizadores autorizados aprofundem a análise (drill-down). O drill-down torna-se o "ponto de controlo" para a autorização reforçada (step-up), o pedido de comentários de justificação ou a concessão de um acesso limitado no tempo. Isto ajuda a manter os dashboards rápidos e reduz a exposição sensível durante o trabalho normal.Minimização de Dados Que Continua a Apoiar as Decisões

Reduza a superfície de exposição desde a conceção (by design)

A minimização de dados não é um slogan. É uma especificação de conceção. Para dados sensíveis na análise de negócios, a minimização tem o seguinte aspeto:- Modelação focada primeiro nas métricas (Metric-first). Pré-calcule as métricas de negócio a partir de fontes sensíveis, guardando apenas os valores derivados sempre que possível.

- Predefinição para coortes e intervalos. Mostre faixas, percentis e contagens, e depois permita o drill-down com controlos.

- Retenção curta para os resultados das consultas. Coloque os agregados em cache para maior velocidade, mas faça com que expirem rapidamente e encripte os dados em cache.

Tabela: escolhas de minimização que protegem o fluxo

| Escolha de conceção | O que os utilizadores veem | Vantagem de segurança | Vantagem de UX |

| Dashboards focados primeiro nos agregados | KPIs, tendências, alertas | Menos exposição de dados brutos | Carregamento mais rápido, menos filtros |

| Campos sensíveis ocultados por defeito | Identificadores parciais | Reduz o risco interno (insider risk) | Menos avisos assustadores |

| Drill-down limitado por políticas | Detalhes apenas quando necessário | Forte ponto de controlo | Os pedidos (prompts) ocorrem raramente |

| Exportações associadas a um propósito | Exportação com justificação e âmbito | Melhor rasto de auditoria (audit trail) | Intenção do utilizador mais clara |

Dados Sensíveis na Análise de Negócios: Classificação em Tempo Real e Encaminhamento Baseado na Sensibilidade

Classificar uma vez, aplicar em todo o lado

A classificação falha quando depende de etiquetas (tags) manuais. Os pipelines de análise ingerem dados de muitos sistemas e a sensibilidade muda com as junções (joins). A classificação em tempo real e as verificações de políticas reduzem os erros. Um padrão prático on-premises:- Classifique os campos na ingestão. Etiquete as colunas como públicas, internas, confidenciais, regulamentadas.

- Anexe as etiquetas à linhagem (lineage). Quando os conjuntos de dados se combinam, a sensibilidade deve acompanhá-los.

- Encaminhe por sensibilidade. Os dados regulamentados permanecem em armazenamentos e pools de processamento com maior controlo.

- Renderize por sensibilidade. A interface de utilizador (UI) utiliza as mesmas etiquetas para decidir o que cada função (role) pode ver.

Padrão UX: "predefinições seguras" com exceções rápidas

Os utilizadores não deveriam escolher os níveis de sensibilidade. O produto deveria fazê-lo. Quando forem necessárias exceções, utilize um fluxo rigoroso: uma pequena caixa de justificação, uma concessão de curta duração e um registo (logging) visível.Avaliação Contínua da Exposição para Superfícies de Análise

Teste as vias de dados, não apenas os hosts

As análises, especialmente as de terceiros, criam novas superfícies de ataque: APIs de consulta, camadas semânticas, armazenamentos de resultados em cache, endpoints de exportação e tokens de integração (embed tokens). A avaliação da exposição tem de se concentrar aí. A análise integrada, obviamente, proporciona uma superfície de exposição muito menor em comparação com as soluções externas de terceiros. O Yellowfin implementa um modelo de segurança rigoroso para proteger os seus dados empresariais a partir de vários ângulos, incluindo o acesso baseado em funções e a encriptação em repouso e em trânsito. Passos práticos:- Verifique as APIs de análise para detetar falhas de autorização ao nível do objeto.

- Teste os tokens de integração (embed tokens) quanto a abusos de repetição (replay) e de âmbito (scope).

- Verifique se as caches não armazenam campos regulamentados em texto simples (plaintext).

- Valide a segurança ao nível da linha e da coluna nas junções (joins).

Tabela: controlos de análise comuns e a sua forma de "baixo atrito"

| Controlo | Versão de elevado atrito | Versão de baixo atrito |

| MFA | Pedido (prompt) em todas as sessões | Reforço (step-up) na exportação ou num drill-down sensível |

| DLP | Bloquear todas as transferências | Marca de água, limitação do âmbito, registo, exigir motivo |

| Controlos de rede | Rede plana | Zona de análise microsegmentada |

| Registo (Logging) | Auditorias manuais | Captura automática de provas para os dashboards de conformidade |

Encriptação e Planeamento Pós-Quântico Sem Surpresas de Latência

Encripte dados em repouso, em trânsito e na cache

On-premises não significa "seguro pela localização". Significa que tem o controlo das chaves, das redes e das políticas. Encripte:- Em repouso em data warehouses, lakehouses e armazenamentos semânticos.

- Em trânsito para o tráfego de consultas e ligações de integração.

- Nas caches, onde as equipas de desempenho cortam muitas vezes caminho.

Análise Comportamental que Deteta a Má Utilização sem Bloquear o Trabalho Real

Linhas de base (baselines) por função, não por utilizador

Os analistas exploram. É esse o seu trabalho. Portanto, a deteção de anomalias tem de compreender os padrões das funções (roles). Bons sinais:- Mudança súbita de agregados para identificadores brutos.

- Consultas que abrangem unidades de negócio invulgares.

- Paginação rápida ou ciclos (loops) de exportação.

- Novas ferramentas ou clientes a acederem à API de consultas.

- Avisos suaves (soft warnings) dentro do produto.

- Reautenticação just-in-time para ações sensíveis.

- Limites de taxa (rate limits) nas exportações, e não nos gráficos.

Conformidade Pronta para Auditoria (Audit-Ready) que Não Cria Trabalho Manual

Torne as provas automáticas

O trabalho de conformidade pode, muitas vezes, quebrar o fluxo tanto para os utilizadores como para os engenheiros. A solução passa pela captura automática de provas:- Registe cada acesso a um campo sensível juntamente com o utilizador, a função, o dispositivo e o propósito.

- Armazene as impressões digitais (fingerprints) das consultas, e não o texto completo da consulta, para o caso de o texto incluir valores literais.

- Registe as decisões de políticas, incluindo as recusas e os acionamentos de autenticação reforçada (step-up).

Risco de Fornecedores e de Terceiros quando os Dados Permanecem On-Premises

Trate o acesso do fornecedor como um fluxo de trabalho controlado e registado

Os fornecedores de análises de terceiros pedem frequentemente extrações de dados ou conectores diretos. Isso cria novas cópias, novas credenciais e novas exposições a nível legal. Se os dados sensíveis na análise de negócios tiverem de permanecer on-premises:- Dê preferência a análises integradas (embedded) que corram dentro do seu perímetro.

- Se um fornecedor tiver de se ligar, restrinja-o a uma zona de rede segmentada.

- Utilize credenciais de curta duração e contas de serviço com âmbito limitado (scoped).

- Reveja os âmbitos (scopes) da API e faça a rotação das chaves num calendário fixo.

Uma Lista de Controlo (Checklist) Prática para Construir Análises que Permanecem no Fluxo

Utilize isto como um guia de implementação para análises on-premises que lidam com dados sensíveis:- Coloque as análises dentro da UI do produto operacional.

- Utilize os agregados por defeito, limitando os detalhes com políticas.

- Aplique a segurança ao nível da linha e da coluna na camada de consulta.

- Classifique os dados na ingestão, mantenha as etiquetas (tags) ao longo da linhagem (lineage).

- Encripte o armazenamento, o trânsito e as caches. Controle as chaves on-premises.

- Adicione a autenticação reforçada (step-up) apenas para ações de risco, como a exportação.

- Execute testes contínuos de exposição nas APIs de consulta e nos caminhos de integração (embed paths).

- Registe automaticamente as decisões de política e os eventos de acesso sensível.

- Trate o acesso do fornecedor como algo raro, delimitado e totalmente registado.