Sensible Daten in der Business-Analytics: On-Premises-Hosting mit Analytics, die den Nutzerfluss nicht unterbrechen

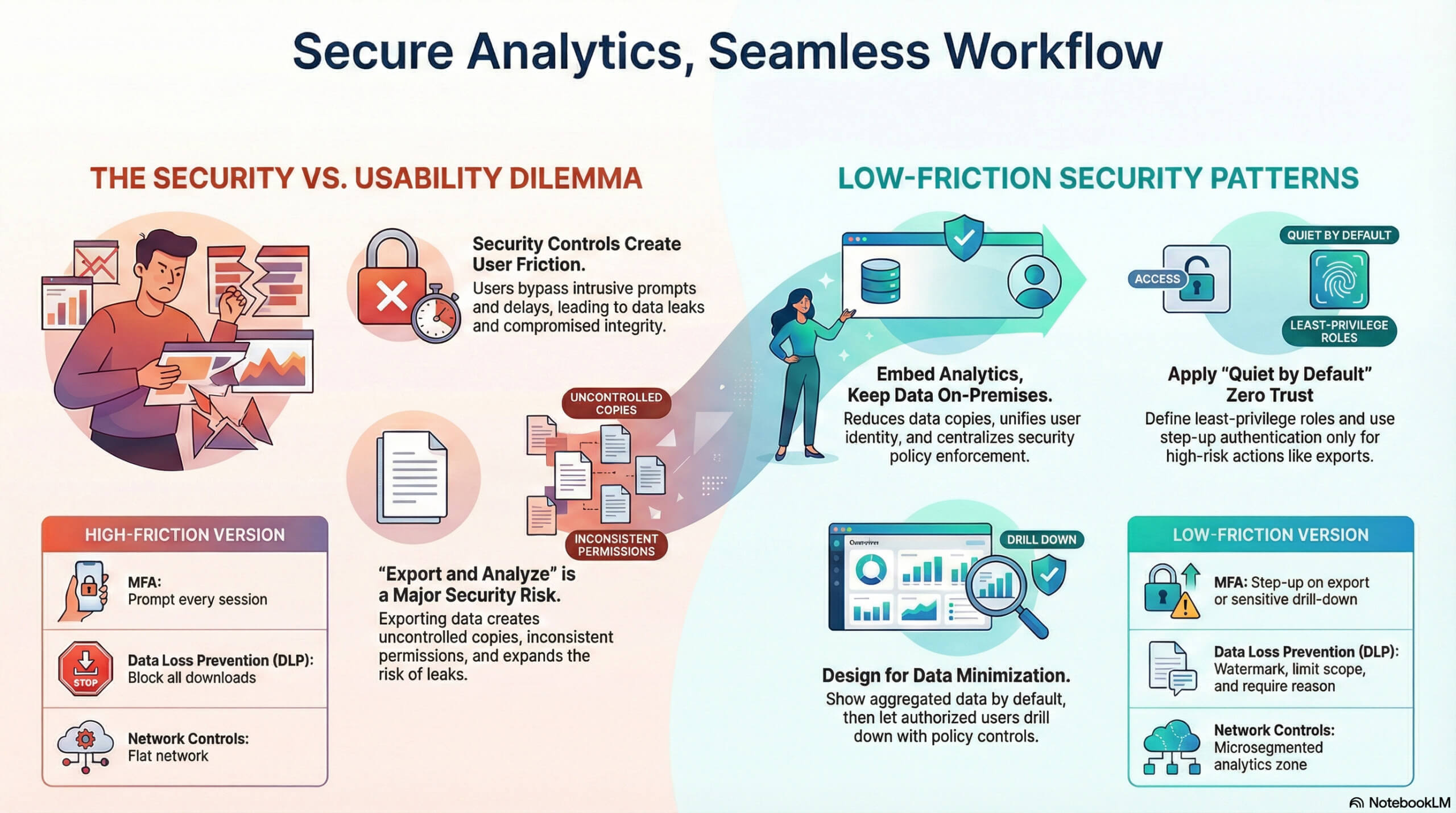

Führungskräfte scheinen manchmal zwei Dinge auf einmal zu wollen. Schnelle Antworten innerhalb operativer Tools und strikte Kontrolle über sensible Daten in Business Analytics. Das Problem ist Reibung. Viele Sicherheitskontrollen fügen Eingabeaufforderungen (Prompts), Verzögerungen und blockierte Bildschirme hinzu. Benutzer umgehen sie oder entwickeln ein „Muskelgedächtnis“, bei dem sie auf eine Schaltfläche klicken, ohne die Bedeutung des angezeigten Textes vollständig zu erfassen – oder ihn überhaupt bewusst gesehen zu haben. Wenn Sie zurückdenken, kommt Ihnen das bekannt vor? Analysten exportieren in Tabellenkalkulationen; das ist oft immer noch ihre Waffe der Wahl. Führungskräfte können das Vertrauen in die Zahlen verlieren, wenn die Geschichte, die sie erzählen, sich nicht auch durch glaubwürdige Fakten stützen lässt. Noch schlimmer ist es, wenn diese Fakten verunreinigt oder kompromittiert sind.

Sicherheit bedeutet mehr, als nur Datenlecks zu verhindern und dafür zu sorgen, dass Daten nicht in die falschen Hände geraten; es geht auch darum, die Integrität der bereitgestellten Daten zu gewährleisten – die Wahrheiten, auf denen Ihre BI-Story und Ihre Analysen aufbauen. Die Sicherstellung dieser Verlässlichkeit faktenbasierter Daten sollte jedoch den Konsum und die Nutzung nicht übermäßig beeinträchtigen, indem die eingesetzten Sicherheitsmethoden zu aufwändig gestaltet werden. Genau das ist der knifflige Teil: Balance und Effektivität.

Die Lösung lautet nicht „weniger Sicherheit“. Es ist eine Sicherheit, die zur Absicht der Benutzer und zum Risiko passt, mit Kontrollen, die die meiste Zeit im Hintergrund ablaufen. On-Premises-Hosting hilft dabei, weil es kritische Datensätze, Schlüssel und die Durchsetzung von Richtlinien nah an den Quellsystemen (Systems of Record) hält. Es reduziert auch die Datenexposition gegenüber Dritten und den Auswirkungsradius (Blast Radius) von Anbietern. Wenn die Balance stimmt, ist die Sicherheit inhärent, effektiv, allgegenwärtig, aber praktisch nicht spürbar.

Eine Frage ist wichtiger als alle anderen: Wie können Analysen im Workflow des Benutzers bleiben, während die Sicherheit strikt bleibt?

Analysen im Produkt belassen, Daten On-Premises

Eingebettete Analysen schlagen „Exportieren und Analysieren“

Der Benutzerfluss (User Flow) bricht ab, wenn Analysen an einem separaten Ort stattfinden. Der Wechsel von Tools bringt zusätzliche Login-Prompts, andere Berechtigungen, andere Filter und weitere Exporte mit sich. Exporte erzeugen Kopien, und Kopien erzeugen Datenlecks.

Ein sichereres Muster sind eingebettete Analysen (Embedded Analytics) innerhalb derselben Anwendung, in der die Benutzer arbeiten. Das bietet drei konkrete Vorteile für sensible Daten in Business Analytics:

- Weniger Datenkopien. Die Berechnungen finden nahe der Quelle statt, und die Ergebnisse fließen direkt in die Benutzeroberfläche (UI).

- Konsistente Identität. Dieselbe Benutzeridentität steuert Aktionen und Analysen.

- Durchsetzung von Richtlinien an einem Ort. Sicherheitsregeln gelten sowohl für Transaktionen als auch für Abfragen.

On-Premises-Hosting begrenzt auch das, was ein externer Analyseanbieter sehen kann. Der Anbieterzugriff wird zur Ausnahme, nicht zur Regel. Das ist wichtig, da Lieferketten- und Drittanbieterrisiken ein wiederkehrendes Thema in Cyber-Richtlinien sind, einschließlich der Prognosen für 2026, die von Morrison Foerster veröffentlicht wurden.

Designziel: unsichtbare Kontrollen, sichtbare Verantwortlichkeit

Sicherheitsteams messen oft die Stärke der Kontrolle, die sie über Bedrohungen haben. Benutzer messen Unterbrechungen bei ihren gewünschten Ergebnissen oder Frustrationen beim Erreichen ihrer Ziele. Das richtige Ziel lautet „standardmäßig still“ (quiet by default), mit starken Beweisen, wenn etwas schiefgeht oder schiefgegangen ist. Es reicht nicht aus, ein „Bauchgefühl“ zu haben, dass etwas nicht stimmt.

Dies deckt sich mit dem Trend zu adaptiven, richtliniengesteuerten Datenkontrollen, wie er in der Trenddiskussion 2026 zur einheitlichen Datensicherung und Automatisierung von Cyberhaven beschrieben wird.

Sensible Daten in Business Analytics: Zero Trust ohne ständige Eingabeaufforderungen

Kontinuierliche Verifizierung, geringste Privilegien (Least Privilege), Mikrosegmentierung

Zero Trust eignet sich gut für Analysen, da der Abfragezugriff (Query Access) ein risikoreicher Pfad ist. Ein einzelner Analyst kann Millionen von Zeilen schneller abrufen als jede App-Ansicht. Einfach gesagt bedeutet die Möglichkeit, umfassend auf Rohdaten zuzugreifen, eine Ausweitung des potenziellen Missbrauchs dieser Daten – und ein Risiko für deren Wahrheitsgehalt, wenn uneingeschränkte Änderungsmöglichkeiten ohne das richtige Maß an Aufsicht gewährt werden.

Wenden Sie Zero Trust so an, dass der Flow nicht unterbrochen wird:

- Abfragerollen mit den geringsten Privilegien. Definieren Sie Rollen nach Aufgaben, nicht nach Titeln. Trennen Sie „KPI-Karten ansehen“ von „Details auf Zeilenebene exportieren“.

- Mikrosegmentierung für Analysedienste. Isolieren Sie die Abfrage-Engine von operativen Netzwerken. Beschränken Sie den Ost-West-Verkehr.

- Risikobasierte Step-up-Authentifizierung nur bei Bedarf. Fügen Sie nicht bei jeder Diagrammansicht MFA-Prompts hinzu. Lösen Sie ein Step-up aus, wenn Daten exportiert, Auswahlbereiche erweitert oder auf regulierte Felder zugegriffen wird.

Dies steht im Einklang mit gängigen Zero-Trust-Richtlinien, einschließlich Identitätsprüfung, Least Privilege und Segmentierung, wie in den Zero-Trust-Erkenntnissen von Archtis beschrieben.

UX-Muster: schrittweise Offenlegung (Progressive Disclosure) sensibler Details

Die meisten Benutzer benötigen keine rohen Identifikatoren. Geben Sie ihnen standardmäßig Aggregate und lassen Sie dann autorisierte Benutzer tiefere Einblicke (Drill-downs) vornehmen. Der Drill-down wird zum „Kontrollpunkt“ für die Step-up-Autorisierung, die Anforderung von Begründungskommentaren oder eine zeitlich begrenzte Zugriffserteilung.

Dies hilft dabei, Dashboards schnell zu halten, und reduziert die Exposition sensibler Daten während der normalen Arbeit.

Datenminimierung, die dennoch Entscheidungen unterstützt

Verringerung der Angriffsfläche durch Design

Datenminimierung ist kein Slogan. Es ist eine Designspezifikation.

Für sensible Daten in Business Analytics sieht Minimierung so aus:

- Metrik-First-Modellierung. Berechnen Sie Geschäftsmetriken aus sensiblen Quellen im Voraus und speichern Sie, wo immer möglich, nur abgeleitete Werte.

- Standardmäßig auf Kohorten und Bereiche setzen. Zeigen Sie Bandbreiten, Perzentile und Anzahlen an und erlauben Sie dann kontrollierte Drill-downs.

- Kurze Aufbewahrungsdauer für Abfrageergebnisse. Cachen Sie Aggregate aus Geschwindigkeitsgründen, lassen Sie sie jedoch schnell verfallen und verschlüsseln Sie die gecachten Daten.

Dies entspricht den grundlegenden Prinzipien der Datensicherheit, wie der Begrenzung der Datenerfassung und der Einschränkung des Zugriffs, zusammengefasst in den Best Practices für Datensicherheit von Palo Alto Networks sowie in Übersichten wie dem Datensicherheits-Primer von Coursera.

Tabelle: Minimierungsoptionen, die den Workflow schützen

| Designentscheidung | Was Benutzer sehen | Sicherheitsgewinn | UX-Gewinn |

| Aggregat-First-Dashboards | KPIs, Trends, Warnmeldungen | Weniger Exposition von Rohdaten | Schnelleres Laden, weniger Filter |

| Sensible Felder standardmäßig maskiert | Partielle Identifikatoren | Senkt Insider-Risiken | Weniger abschreckende Warnungen |

| Drill-down durch Richtlinien beschränkt | Details nur bei Bedarf | Starker Kontrollpunkt | Prompts treten selten auf |

| Zweckgebundene Exporte | Export mit Grund und Umfang | Besserer Audit-Trail | Klarere Benutzerabsicht |

Sensible Daten in Business Analytics: Echtzeit-Klassifizierung und sensibilitätsbasiertes Routing

Einmal klassifizieren, überall durchsetzen

Klassifizierung scheitert, wenn sie von manuellen Tags abhängt. Analyse-Pipelines nehmen Daten aus vielen Systemen auf, und die Sensibilität ändert sich mit Verknüpfungen (Joins). Echtzeit-Klassifizierung und Richtlinienprüfungen reduzieren Fehler.

Ein praktisches On-Premises-Muster:

- Felder bei der Aufnahme klassifizieren. Spalten als öffentlich, intern, vertraulich oder reguliert markieren.

- Tags an die Herkunft (Lineage) anhängen. Wenn Datensätze kombiniert werden, sollte die Sensibilität folgen.

- Nach Sensibilität routen. Regulierte Daten bleiben in Speichern und Compute-Pools mit höheren Kontrollstufen.

- Nach Sensibilität rendern. Die Benutzeroberfläche verwendet dieselben Tags, um zu entscheiden, was eine bestimmte Rolle sehen darf.

Dies unterstützt den Trend hin zu einheitlichem, automatisiertem Schutz und schnellen Durchsetzungsschleifen, wie in den Trends 2026 von Cyberhaven erörtert.

UX-Muster: „sichere Standardeinstellungen“ (safe defaults) mit schnellen Ausnahmen

Benutzer sollten keine Sensibilitätsstufen auswählen. Das Produkt sollte dies tun. Wenn Ausnahmen erforderlich sind, nutzen Sie einen engen Ablauf: ein kleines Begründungsfeld, eine kurzlebige Berechtigung und eine sichtbare Protokollierung.

Kontinuierliche Bewertung der Exposition für Analyseoberflächen

Testen Sie die Datenpfade, nicht nur die Hosts

Analysen, insbesondere Analysen von Drittanbietern, schaffen neue Angriffsflächen: Abfrage-APIs, semantische Schichten, gecachte Ergebnisspeicher, Export-Endpunkte und Embed-Tokens. Darauf muss sich die Bewertung der Exposition (Exposure Assessment) konzentrieren.

Eingebettete Analysen bieten im Vergleich zu externen Drittanbieterlösungen naturgemäß eine viel kleinere Angriffsfläche. Yellowfin implementiert ein umfassendes Sicherheitsmodell, um Ihre Geschäftsdaten aus mehreren Blickwinkeln zu schützen, einschließlich rollenbasierter Zugriffskontrolle und Verschlüsselung (At-Rest und In-Transit).

Praktische Schritte:

- Scannen von Analyse-APIs auf fehlerhafte Autorisierung auf Objektebene.

- Testen von Embed-Tokens auf Replay- und Scope-Missbrauch.

- Überprüfen, ob Caches regulierte Felder nicht im Klartext speichern.

- Validieren der Sicherheit auf Zeilen- und Spaltenebene bei Verknüpfungen (Joins).

Tabelle: gängige Analysekontrollen und ihre reibungsarme (low-friction) Form

| Kontrolle | Reibungsstarke Version | Reibungsarme Version |

| MFA (Multi-Faktor) | Prompt bei jeder Sitzung | Step-up bei Export oder sensiblem Drill-down |

| DLP (Data Loss Prevention) | Alle Downloads blockieren | Wasserzeichen, Scope begrenzen, protokollieren, Grund verlangen |

| Netzwerkkontrollen | Flaches Netzwerk | Mikrosegmentierte Analysezone |

| Protokollierung (Logging) | Manuelle Audits | Automatische Beweiserfassung für Compliance-Dashboards |

Verschlüsselung und Post-Quanten-Planung ohne Latenz-Überraschungen

Daten im Ruhezustand (at rest), bei der Übertragung (in transit) und im Cache verschlüsseln

On-Premises bedeutet nicht „sicher durch den Standort“. Es bedeutet, dass Sie die Kontrolle über Schlüssel, Netzwerke und Richtlinien haben. Verschlüsseln Sie:

- Im Ruhezustand (at rest) in Data Warehouses, Lakehouses und semantischen Speichern.

- Bei der Übertragung (in transit) für Abfrageverkehr und Embed-Verbindungen.

- In Caches, bei denen Performance-Teams oft an der Sicherheit sparen.

Gängige Richtlinien heben Verschlüsselung und starke Protokolle durchweg als Kernkontrollen hervor, einschließlich der Best-Practice-Zusammenfassung von Palo Alto Networks.

Beginnen Sie bei langlebigen, sensiblen Daten in Business Analytics mit der Planung für die Post-Quanten-Ära. Behandeln Sie dies als einen Punkt auf der Roadmap, der an Datenaufbewahrungsfristen und Schlüsselrotation gebunden ist, und nicht als plötzlichen Umbau. Strategiediskussionen für das Jahr 2026 ordnen die Post-Quanten-Planung oft breiteren Schutzprogrammen zu, einschließlich der planungsorientierten Leitfäden in Hyperproofs Datenschutzstrategien für 2026.

Verhaltensanalyse, die Missbrauch erkennt, ohne die eigentliche Arbeit zu blockieren

Baselines nach Rolle, nicht nach Benutzer

Analysten explorieren Daten. Das ist ihr Job. Die Anomalieerkennung muss also Rollenmuster verstehen.

Gute Signale:

- Plötzlicher Wechsel von Aggregaten zu rohen Identifikatoren.

- Abfragen, die ungewöhnliche Geschäftsbereiche umfassen.

- Schnelle Paginierung oder Export-Schleifen.

- Neue Tools oder Clients, die auf die Abfrage-API zugreifen.

Wenden Sie dann Reaktionen an, die den Flow intakt halten:

- Sanfte Warnungen (Soft Warnings) im Produkt.

- Just-in-Time-Re-Authentifizierung für sensible Aktionen.

- Ratenbegrenzungen (Rate Limits) für Exporte, nicht für Diagramme.

Dies entspricht dem Bestreben der Branche hin zu kontextbezogenen Kontrollen und adaptiven Entscheidungen, wie es in mehreren Zusammenfassungen von Sicherheitstrends für 2026 erörtert wird, darunter Cyberhaven und die breitere Einordnung des Trends durch die Tarian Group.

Audit-Ready Compliance, die keine manuelle Arbeit verursacht

Beweise automatisch erfassen

Compliance-Arbeit kann oft den Flow sowohl für Benutzer als auch für Ingenieure stören. Die Lösung ist eine automatische Beweiserfassung:

- Protokollieren Sie jeden Zugriff auf sensible Felder mit Angabe von Benutzer, Rolle, Gerät und Zweck.

- Speichern Sie Abfrage-Fingerabdrücke (Fingerprints), nicht den vollständigen Abfragetext, falls der Text literale Werte enthält.

- Erfassen Sie Richtlinienentscheidungen, einschließlich Ablehnungen und Step-up-Auslöser.

Dies unterstützt „Audit by Query“ anstelle von „Audit by Spreadsheet“. Compliance-Automatisierung ist ein wiederkehrendes Thema in Governance-fokussierten Sicherheitsrichtlinien, einschließlich des strukturierten Kontrollansatzes, der in Hyperproof beschrieben wird.

Anbieter- und Drittanbieterrisiko, wenn Daten On-Premises bleiben

Behandeln Sie den Anbieterzugriff als kontrollierten, protokollierten Workflow

Externe Analyseanbieter fragen oft nach Datenextrakten oder direkten Konnektoren. Das schafft neue Kopien, neue Anmeldedaten und neue rechtliche Risiken.

Wenn sensible Daten in Business Analytics On-Premises bleiben müssen:

- Bevorzugen Sie eingebettete Analysen, die innerhalb Ihrer Grenzen laufen.

- Wenn sich ein Anbieter verbinden muss, beschränken Sie ihn auf eine segmentierte Netzwerkzone.

- Verwenden Sie kurzlebige Anmeldedaten und Service-Konten mit beschränktem Zugriff (Scoped).

- Überprüfen Sie API-Scopes und rotieren Sie Schlüssel nach einem festen Zeitplan.

Regulatorische Anforderungen und Erwartungen an kritische Infrastrukturen deuten zunehmend auf eine stärkere Governance und eine strengere Prüfung von Anbietern hin, wie in den Cyber- und Datenschutzprognosen für 2026 von Morrison Foerster festgestellt wird.

Eine praktische Build-Checkliste für Analysen, die im Flow bleiben

Verwenden Sie dies als Implementierungsleitfaden für On-Premises-Analysen, die sensible Daten verarbeiten:

- Integrieren Sie Analysen in die UI des operativen Produkts.

- Setzen Sie standardmäßig auf Aggregate und schränken Sie Details durch Richtlinien ein.

- Erzwingen Sie Sicherheit auf Zeilen- und Spaltenebene in der Abfrageschicht (Query Layer).

- Klassifizieren Sie Daten bei der Aufnahme (Ingestion) und führen Sie Tags durch die gesamte Herkunft (Lineage).

- Verschlüsseln Sie Speicher, Übertragung und Caches. Behalten Sie die Kontrolle über die Schlüssel On-Premises.

- Fügen Sie Step-up-Auth nur für riskante Aktionen hinzu, z. B. beim Export.

- Führen Sie kontinuierliche Expositionstests an Abfrage-APIs und Embed-Pfaden durch.

- Protokollieren Sie Richtlinienentscheidungen und sensible Zugriffsereignisse automatisch.

- Behandeln Sie den Anbieterzugriff als selten, abgrenzt und vollständig protokolliert.

On-Premises-Hosting ist keine Nostalgie. Es ist eine Entscheidung für Kontrolle. In Kombination mit eingebetteten Analysen und reibungsarmen Sicherheitsmustern ermöglicht es Teams, schnell Erkenntnisse zu liefern, ohne dass sensible Daten in Business Analytics zu einem ständigen Risiko-Kompromiss werden.

FAQ (Häufig gestellte Fragen)

Wie lassen sich Zero-Trust-Prinzipien speziell auf die Autorisierung von Analyseabfragen anwenden, ohne legitime Analysen zu blockieren?

Wenden Sie aufgabenbezogene Abfragerollen (Query Roles) mit geringsten Privilegien an, isolieren Sie die Analyse-/Abfrageschicht durch Mikrosegmentierung und nutzen Sie die risikobasierte Step-up-Authentifizierung nur für risikoreichere Aktionen (Exporte, erweiterte Scopes, regulierte Felder), nicht aber für das routinemäßige Betrachten von Dashboards.

Welche regulatorischen Anforderungen (DSGVO/GDPR, HIPAA, SOX) wirken sich am direktesten auf die Handhabung von On-Premises-Analysedaten aus?

In der Praxis führen diese am direktesten zu: strengen Zugriffskontrollen (Zeilen-/Spaltenebene bei Bedarf), Verschlüsselung (At-Rest / In-Transit / Im Cache), minimierten/standardmäßig aggregierten Ansichten, kontrollierten Exporten sowie der prüfungssicheren Beweiserfassung (Audit-Ready) für sensible Zugriffe und Richtlinienentscheidungen.

Wie können Organisationen validieren, dass Verschlüsselung und Zugriffskontrollen tatsächlich sensible Analysedaten schützen?

Testen Sie kontinuierlich analysespezifische Pfade: Scannen Sie Abfrage-APIs auf Autorisierungsfehler, validieren Sie die Zeilen-/Spaltensicherheit bei Joins, stellen Sie sicher, dass Caches keine regulierten Felder im Klartext speichern, und testen Sie Embed-Tokens auf Replay- oder Scope-Missbrauch. Untermauern Sie dies dann mit der automatisierten Protokollierung (Logging) von Zugriffen auf sensible Felder und Richtlinienentscheidungen.

Was ist der Unterschied zwischen der Verhinderung von Datenexposition und der Verhinderung legitimer Analyse-Workflows?

Die Verhinderung von Exposition besteht darin, standardmäßig sichere Ansichten zu verwenden (Aggregate, maskierte Felder) und sensible Drill-downs/Exporte abzusichern; die Verhinderung von Workflows ist eine pauschale Blockierung, die Benutzer zu Workarounds (wie z. B. Exporten) zwingt.

Wie kann die verhaltensbasierte Anomalieerkennung zwischen einem Datenanalysten, der Erkenntnisse gewinnt, und einem Innentäter (Insider Threat), der Daten exfiltriert, unterscheiden?

Legen Sie ein Baseline-Verhalten pro Rolle fest und markieren Sie dann Abweichungen wie den Wechsel von Aggregaten zu rohen Identifikatoren, ungewöhnliche Geschäftsbereichs-Umfänge, schnelle Paginierungs-/Export-Schleifen oder neue Clients, die Abfrage-APIs nutzen. Reagieren Sie mit reibungsarmen Kontrollen (sanfte Warnungen, Just-in-Time-Re-Authentifizierung, Export-Ratenbegrenzungen).

Welche Auswirkungen auf die Latenz oder Abfrageleistung müssen Unternehmen erwarten, wenn sie Analysesystemen Sicherheitskontrollen hinzufügen?

Wenn Kontrollen „standardmäßig still“ (quiet by default) sind, bleibt die normale Nutzung von Dashboards schnell (Caching von Aggregaten, minimale Prompts), während zusätzliche Reibung für risikoreichere Aktionen wie sensible Drill-downs und Exporte reserviert wird (Step-up-Authentifizierung, Scope-Limits, Logging).

Sollte die Analyseverarbeitung auf dedizierter On-Premises-Infrastruktur erfolgen, isoliert von operativen Systemen?

Ja – behandeln Sie Analysen als eine segmentierte Zone: Isolieren Sie die Abfrage-Engine von operativen Netzwerken, schränken Sie den Ost-West-Verkehr ein und leiten Sie regulierte Daten an Compute-Pools mit höherer Kontrolle weiter.

Wie stehen Datenminimierungsstrategien im Konflikt mit dem Bedarf an umfassenden Analyse-Datensätzen?

Sie geraten in Konflikt, wenn durch Minimierung der erforderliche Kontext entfernt wird; lösen Sie dies, indem Sie Aggregat-First-Modelle (Metrik-First, Kohorten/Bereiche) entwerfen und kontrollierte Drill-downs nur dann zulassen, wenn sie gerechtfertigt und autorisiert sind.

Welche Rolle sollten externe Analyseanbieter in Organisationen spielen, die ausschließlich On-Premises-Daten verwenden?

Der Anbieterzugriff sollte die Ausnahme sein: Bevorzugen Sie eingebettete Analysen innerhalb Ihrer eigenen Systemgrenzen; wenn sich ein Anbieter verbinden muss, beschränken Sie ihn auf eine segmentierte Zone mit kurzlebigen, im Scope eingeschränkten Anmeldedaten, einer strengen Überprüfung der API-Scopes / Schlüsselrotation sowie einer vollständigen Protokollierung.

Wie messen Unternehmen, ob ihre Analyse-Sicherheit in einem angemessenen Verhältnis zum tatsächlichen Geschäftsrisiko steht?

Stimmen Sie die Kontrollen auf Absicht und Risiko ab (Step-up nur bei riskanten Aktionen), validieren Sie echte Expositionspunkte (APIs/Tokens/Caches/Joins) und stellen Sie „sichtbare Verantwortlichkeit“ durch automatische Beweiserfassung sicher, anstatt durch ständige Reibung (Friction) für den Benutzer.

Welche Beziehung besteht zwischen der Genauigkeit der Datenklassifizierung und einer effektiven Zugriffskontrolle bei Analysen?

Die Klassifizierung ist das Fundament: Taggen Sie Felder bei der Aufnahme, geben Sie die Sensibilität über Lineage/Joins weiter und nutzen Sie diese Tags, um Berechnungen zu routen und zu rendern, was jede Rolle sehen darf. Fehlerhafte Tags bedeuten eine fehlerhafte Durchsetzung.

Wie können Unternehmen analysebezogene Datenexpositionen vorhersagen und verhindern, bevor es zu Vorfällen kommt?

Kombinieren Sie eine kontinuierliche Expositionsbewertung (Testen von Abfrage-APIs, Tokens, Caches und Join-Verhalten) mit einer rollenbasierten Anomalieerkennung und automatisierten Audit-Beweisen, sodass Probleme frühzeitig erkannt werden, ohne legitime Analysen zu stören.