Datos sensibles en analítica empresarial: alojamiento on-premises con analítica que no interrumpe el flujo del usuario

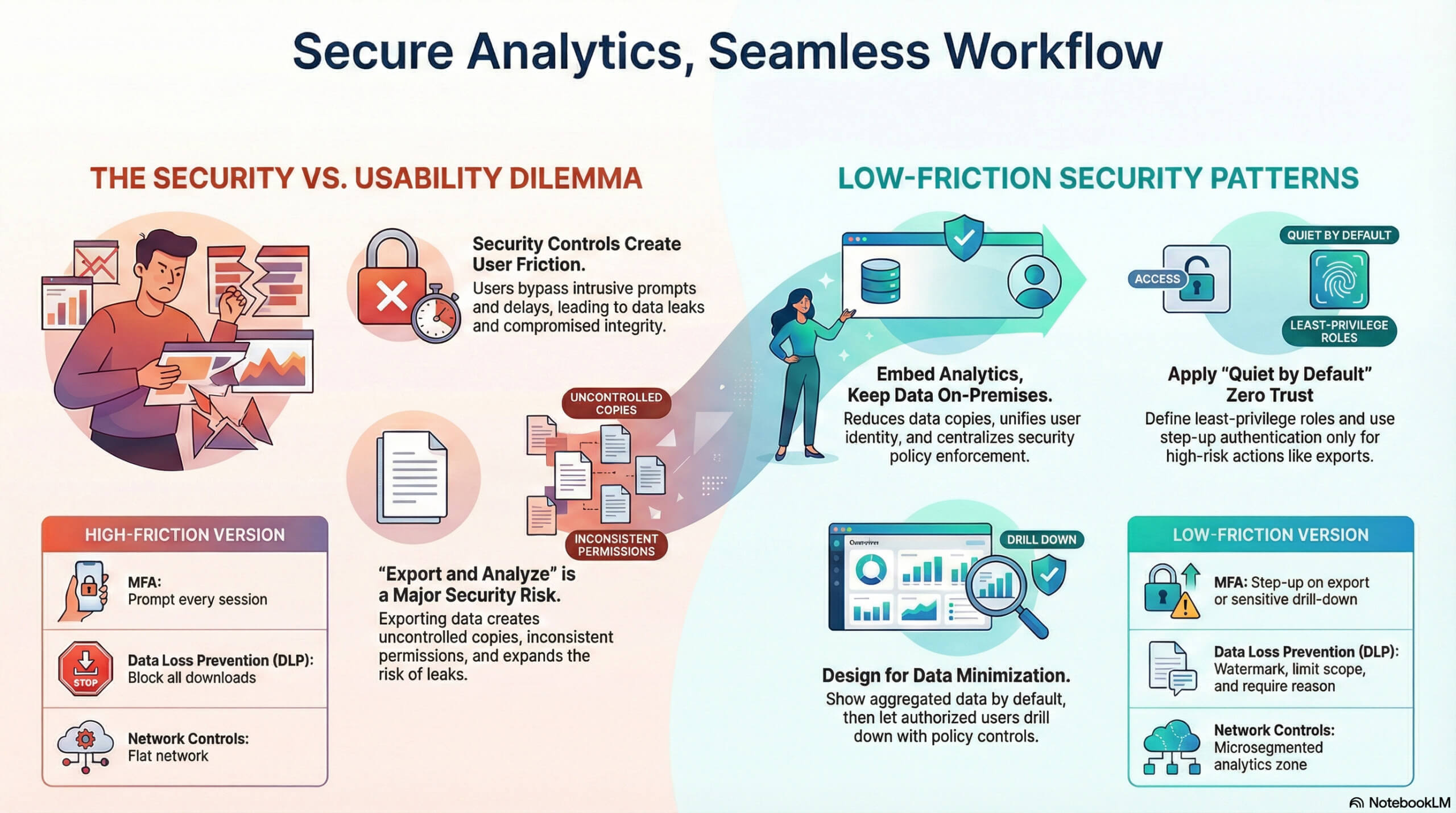

A veces, los ejecutivos parecen querer dos cosas a la vez. Respuestas rápidas dentro de las herramientas operativas y un control estricto sobre los datos sensibles en el análisis empresarial (business analytics). El problema es la fricción. Muchos controles de seguridad añaden avisos (prompts), retrasos y pantallas bloqueadas. Los usuarios los esquivan o desarrollan una "memoria muscular" en la que hacen clic en un botón sin asimilar por completo el significado del texto que ven, o sin haberlo visto conscientemente. Si hace memoria, ¿le resulta familiar? Los analistas exportan a hojas de cálculo; a menudo sigue siendo su arma preferida. Los líderes pueden perder la confianza en los números cuando la historia que cuentan no se sustenta también en hechos creíbles. Peor aún si esos hechos están contaminados o comprometidos.

La seguridad es algo más que evitar fugas de datos y que estos caigan en las manos equivocadas; también se trata de garantizar la integridad de los datos suministrados, las verdades sobre las que se construyen su historia de BI y sus análisis. Pero garantizar esa certeza de los datos fácticos no debería interferir indebidamente con el consumo y uso de los mismos al hacer que los métodos de seguridad empleados sean demasiado onerosos. Esa es la parte complicada: el equilibrio y la eficacia.

La solución no es "menos seguridad". Es una seguridad que se adapte a la intención del usuario y al riesgo, con controles que permanezcan en segundo plano la mayor parte del tiempo. El alojamiento local (on-premises) ayuda porque mantiene los conjuntos de datos críticos, las claves y la aplicación de políticas cerca de los sistemas de registro (systems of record). También reduce la exposición de los datos a terceros y el radio de impacto (blast radius) de los proveedores. Cuando el equilibrio es el adecuado, la seguridad es endémica, efectiva, omnipresente, pero prácticamente imperceptible.

Hay una pregunta que importa más que las demás: ¿cómo pueden los análisis permanecer dentro del flujo de trabajo del usuario mientras la seguridad se mantiene estricta?

Mantenga el análisis en el producto y los datos a nivel local (On-Premises)

El análisis integrado (embedded) supera a la opción de "exportar y analizar"

El flujo del usuario se interrumpe cuando los análisis residen en un destino separado. Cambiar de herramientas añade avisos de inicio de sesión, permisos diferentes, filtros diferentes y más exportaciones. Las exportaciones crean copias, y las copias crean fugas.

Un patrón más seguro es el análisis integrado (embedded analytics) dentro de la misma aplicación donde trabajan los usuarios. Esto ofrece tres beneficios concretos para los datos sensibles en el análisis empresarial:

- Menos copias de datos. El procesamiento se realiza cerca de la fuente y los resultados fluyen hacia la interfaz de usuario (UI).

- Identidad coherente. La misma identidad de usuario controla las acciones y los análisis.

- Aplicación de políticas en un solo lugar. Las reglas de seguridad se aplican tanto a las transacciones como a las consultas (queries).

El alojamiento local también limita lo que puede ver un proveedor de análisis externo. El acceso del proveedor se convierte en una excepción, no en la regla. Esto es importante porque el riesgo de la cadena de suministro y de terceros es un tema recurrente en las directrices cibernéticas, incluidas las predicciones para 2026 publicadas por Morrison Foerster.

Objetivo de diseño: controles invisibles, responsabilidad visible

Los equipos de seguridad a menudo miden la fuerza del control que tienen sobre las amenazas. Los usuarios miden las interrupciones en sus resultados deseados o las frustraciones para lograr sus objetivos. El objetivo correcto es "silencioso por defecto" (quiet by default), con pruebas sólidas cuando algo va, o ha ido, mal. No basta con tener la "corazonada" de que algo no está bien.

Esto coincide con el cambio hacia controles de datos adaptativos y basados en políticas descritos en el debate de tendencias de 2026 sobre protección de datos unificada y automatización de Cyberhaven.

Datos sensibles en el análisis empresarial: Zero Trust sin avisos constantes

Verificación continua, privilegio mínimo (least privilege), microsegmentación

Zero Trust (Confianza Cero) encaja bien en el análisis porque el acceso a consultas es una vía de alto riesgo. Un solo analista puede extraer millones de filas más rápido que cualquier pantalla de aplicación. En pocas palabras, la capacidad de acceder a los datos sin procesar de forma exhaustiva significa una expansión de los posibles usos indebidos de esos datos, y un riesgo para la veracidad de los mismos si se otorga una capacidad ilimitada para modificarlos sin el nivel de supervisión adecuado.

Aplique Zero Trust de maneras que no interrumpan el flujo:

- Roles de consulta con privilegios mínimos. Defina los roles por tarea, no por título. Separe "ver tarjetas de KPI" de "exportar detalles a nivel de fila".

- Microsegmentación para servicios de análisis. Aísle el motor de consultas de las redes operativas. Restrinja el tráfico este-oeste.

- Autenticación reforzada (step-up) basada en el riesgo solo cuando sea necesario. No añada avisos de MFA a cada vista de gráfico. Active la autenticación reforzada al exportar, al ampliar los rangos de selección o al acceder a campos regulados.

Esto se alinea con las directrices comunes de Zero Trust, que incluyen la verificación de identidad, el privilegio mínimo y la segmentación, como se describe en la información sobre Zero Trust de Archtis.

Patrón UX: divulgación progresiva de detalles sensibles

La mayoría de los usuarios no necesitan identificadores sin procesar. Ofrézcales agregados por defecto, y luego permita a los usuarios autorizados profundizar (drill-down). La profundización se convierte en el "punto de control" para la autorización reforzada (step-up), la solicitud de comentarios de justificación o una concesión de acceso por tiempo limitado.

Esto ayuda a mantener la velocidad de los paneles de control y reduce la exposición sensible durante el trabajo normal.

Minimización de datos que aún respalda las decisiones

Reduzca la superficie de exposición desde el diseño (by design)

La minimización de datos no es un eslogan. Es una especificación de diseño.

Para los datos sensibles en el análisis empresarial, la minimización se ve así:

- Modelado centrado en las métricas (Metric-first). Precalcule las métricas comerciales a partir de fuentes sensibles, almacene solo los valores derivados siempre que sea posible.

- Por defecto a cohortes y rangos. Muestre bandas, percentiles y recuentos, y luego permita la profundización (drill-down) con controles.

- Retención corta para los resultados de las consultas. Almacene los agregados en caché para mayor velocidad, pero haga que caduquen rápidamente y cifre los datos almacenados en caché.

Esto se corresponde con los principios básicos de seguridad de datos, como limitar la recopilación y restringir el acceso, tal y como se resume en las mejores prácticas de seguridad de datos de Palo Alto Networks y también en resúmenes como el manual de seguridad de datos de Coursera.

Tabla: opciones de minimización que protegen el flujo

| Opción de diseño | Lo que ven los usuarios | Ventaja de seguridad | Ventaja de UX |

| Paneles de control centrados en agregados | KPIs, tendencias, alertas | Menor exposición a datos sin procesar | Carga más rápida, menos filtros |

| Campos sensibles ocultos por defecto | Identificadores parciales | Reduce el riesgo interno (insider risk) | Menos advertencias intimidantes |

| Profundización (Drill-down) limitada por políticas | Detalles solo cuando es necesario | Fuerte punto de control | Los avisos (prompts) ocurren raramente |

| Exportaciones vinculadas a un propósito | Exportación con motivo y alcance | Mejor pista de auditoría (audit trail) | Intención del usuario más clara |

Datos sensibles en el análisis empresarial: Clasificación en tiempo real y enrutamiento basado en la sensibilidad

Clasificar una vez, aplicar en todas partes

La clasificación falla cuando depende de etiquetas (tags) manuales. Las canalizaciones (pipelines) de análisis ingieren datos de muchos sistemas, y la sensibilidad cambia con las uniones (joins). La clasificación en tiempo real y las comprobaciones de políticas reducen los errores.

Un patrón práctico a nivel local (on-prem):

- Clasifique los campos en la ingesta. Etiquete las columnas como públicas, internas, confidenciales, reguladas.

- Adjunte etiquetas al linaje (lineage). Cuando los conjuntos de datos se combinan, la sensibilidad debe seguirlos.

- Enrute por sensibilidad. Los datos regulados permanecen en almacenes y grupos de procesamiento de mayor control.

- Renderice por sensibilidad. La interfaz de usuario (UI) utiliza las mismas etiquetas para decidir qué puede ver cada rol.

Esto apoya el movimiento hacia la protección unificada y automatizada, así como a los ciclos rápidos de aplicación, discutidos en las tendencias para 2026 de Cyberhaven.

Patrón UX: "valores predeterminados seguros" con excepciones rápidas

Los usuarios no deberían elegir los niveles de sensibilidad. El producto debería hacerlo. Cuando se necesiten excepciones, utilice un flujo estricto: un pequeño cuadro de justificación, una concesión de corta duración y un registro (logging) visible.

Evaluación continua de la exposición para superficies de análisis

Pruebe las rutas de datos, no solo los hosts

El análisis, especialmente el de terceros, crea nuevas superficies de ataque: APIs de consultas, capas semánticas, almacenes de resultados en caché, endpoints de exportación y tokens de integración (embed tokens). La evaluación de la exposición debe centrarse ahí.

El análisis integrado, por supuesto, proporciona una superficie de exposición mucho menor en comparación con las soluciones externas de terceros. Yellowfin implementa un modelo de seguridad exhaustivo para proteger sus datos empresariales desde múltiples ángulos, incluyendo el acceso basado en roles y el cifrado en reposo y en tránsito.

Pasos prácticos:

- Escanee las APIs de análisis para detectar fallos de autorización a nivel de objeto.

- Pruebe los tokens de integración para detectar abusos de repetición (replay) y de alcance (scope).

- Verifique que las cachés no almacenen campos regulados en texto plano (plaintext).

- Valide la seguridad a nivel de fila y columna durante las uniones (joins).

Tabla: controles de análisis comunes y su forma de "baja fricción"

| Control | Versión de alta fricción | Versión de baja fricción |

| MFA | Aviso (prompt) en cada sesión | Autenticación reforzada (Step-up) al exportar o en profundizaciones sensibles |

| DLP | Bloquear todas las descargas | Marca de agua, limitar alcance, registrar, requerir motivo |

| Controles de red | Red plana | Zona de análisis microsegmentada |

| Registro (Logging) | Auditorías manuales | Captura automática de pruebas para paneles de control de cumplimiento |

Cifrado y planificación poscuántica sin sorpresas de latencia

Cifre los datos en reposo, en tránsito y en la caché

Local (on-prem) no significa "seguro por la ubicación". Significa que usted controla las claves, las redes y las políticas. Cifre:

- En reposo en almacenes de datos (data warehouses), lakehouses y almacenes semánticos.

- En tránsito para el tráfico de consultas y las conexiones de integración.

- En las cachés donde los equipos de rendimiento a menudo toman atajos.

Las directrices generales señalan constantemente el cifrado y los protocolos fuertes como controles básicos, incluido el resumen de mejores prácticas de Palo Alto Networks.

Para los datos sensibles de larga duración en el análisis empresarial, comience a planificar la preparación poscuántica. Trátelo como un elemento de la hoja de ruta (roadmap) vinculado a los períodos de retención de datos y la rotación de claves, no como una reconstrucción repentina. Los debates estratégicos para 2026 suelen situar la planificación poscuántica junto a programas de protección más amplios, incluidas las orientaciones centradas en la planificación en las estrategias de protección de datos para 2026 de Hyperproof.

Análisis de comportamiento que detecta el uso indebido sin bloquear el trabajo real

Líneas base (baselines) por rol, no por usuario

Los analistas exploran. Es su trabajo. Por lo tanto, la detección de anomalías debe comprender los patrones de los roles.

Buenas señales:

- Cambio repentino de agregados a identificadores sin procesar.

- Consultas que abarcan unidades de negocio inusuales.

- Paginación rápida o bucles de exportación.

- Nuevas herramientas o clientes accediendo a la API de consultas.

Luego, aplique respuestas que mantengan intacto el flujo:

- Advertencias leves (soft warnings) dentro del producto.

- Reautenticación justo a tiempo (just-in-time) para acciones sensibles.

- Límites de frecuencia (rate limits) en las exportaciones, no en los gráficos.

Esto coincide con el impulso de la industria hacia controles sensibles al contexto y decisiones adaptativas discutidas en varios resúmenes de tendencias de seguridad para 2026, incluyendo Cyberhaven y el marco de tendencias más amplio del Tarian Group.

Cumplimiento preparado para auditorías que no genera trabajo manual

Haga que las pruebas sean automáticas

El trabajo de cumplimiento a menudo puede interrumpir el flujo tanto para los usuarios como para los ingenieros. La solución es la captura automática de pruebas:

- Registre cada acceso a un campo sensible junto con el usuario, el rol, el dispositivo y el propósito.

- Almacene las huellas digitales (fingerprints) de las consultas, no el texto completo de la consulta, en caso de que el texto incluya valores literales.

- Registre las decisiones de las políticas, incluidos los rechazos y los factores desencadenantes de la autenticación reforçada (step-up).

Esto respalda la "auditoría por consulta" en lugar de la "auditoría por hoja de cálculo". La automatización del cumplimiento es un tema recurrente en las pautas de seguridad centradas en la gobernanza, incluido el enfoque de controles estructurados descrito en Hyperproof.

Riesgo de proveedores y terceros cuando los datos permanecen a nivel local (On-Premises)

Trate el acceso de los proveedores como un flujo de trabajo controlado y registrado

Los proveedores de análisis externos suelen pedir extracciones de datos o conectores directos. Eso crea nuevas copias, nuevas credenciales y una nueva exposición legal.

Si los datos sensibles en el análisis empresarial deben permanecer a nivel local (on-premises):

- Prefiera los análisis integrados (embedded) que se ejecutan dentro de su límite.

- Si un proveedor debe conectarse, restrínjalo a una zona de red segmentada.

- Utilice credenciales de corta duración y cuentas de servicio con un alcance limitado (scoped).

- Revise los alcances de la API (API scopes) y rote las claves en un horario fijo.

Las expectativas en materia de regulación e infraestructuras críticas apuntan cada vez más hacia una gobernanza más fuerte y un mayor escrutinio de los proveedores, como se señala en las predicciones cibernéticas y de privacidad para 2026 de Morrison Foerster.

Una lista de verificación práctica para crear análisis que se mantienen en el flujo

Utilice esto como una guía de implementación para los análisis locales que procesan datos sensibles:

- Coloque los análisis dentro de la interfaz de usuario (UI) del producto operativo.

- Por defecto, use agregados, limitando los detalles con políticas.

- Aplique la seguridad a nivel de fila y columna en la capa de consulta.

- Clasifique los datos durante la ingesta, mantenga las etiquetas (tags) a lo largo del linaje (lineage).

- Cifre el almacenamiento, el tránsito y las cachés. Controle las claves a nivel local.

- Añada la autenticación reforzada (step-up) solo para acciones de riesgo, como la exportación.

- Ejecute pruebas de exposición continuas en las APIs de consulta y las rutas de integración (embed paths).

- Registre automáticamente las decisiones de políticas y los eventos de acceso sensible.

- Trate el acceso de los proveedores como algo raro, delimitado y completamente registrado.

El alojamiento local no es una cuestión de nostalgia. Es una opción de control. Cuando se combina con el análisis integrado y patrones de seguridad de baja fricción, permite a los equipos ofrecer conocimientos rápidos sin convertir los datos sensibles en el análisis empresarial en un constante compromiso de riesgo.

Preguntas frecuentes (FAQ)

¿Cómo se aplican los principios de Zero Trust específicamente a la autorización de consultas de análisis sin bloquear los análisis legítimos?

Aplique roles de consulta de privilegios mínimos por tarea, aísle la capa de análisis/consultas mediante microsegmentación y utilice la autenticación reforzada basada en el riesgo solo para acciones de mayor riesgo (exportaciones, alcances más amplios, campos regulados), no para la visualización rutinaria de paneles de control.

¿Qué requisitos normativos (GDPR, HIPAA, SOX) tienen el impacto más directo en el manejo de datos de análisis a nivel local?

En la práctica, estos exigen de forma más directa: controles de acceso estrictos (a nivel de fila/columna donde sea necesario), cifrado en reposo/en tránsito/en caché, vistas minimizadas/agregadas por defecto, exportaciones controladas y captura de pruebas listas para auditoría de los accesos a datos sensibles y las decisiones de políticas.

¿Cómo pueden las organizaciones validar que el cifrado y los controles de acceso protegen realmente los datos analíticos sensibles?

Pruebe continuamente las rutas específicas del análisis: escanee las APIs de consultas en busca de fallos de autorización, valide la seguridad de fila/columna en las uniones (joins), verifique que las cachés no almacenen campos regulados en texto plano (plaintext) y pruebe los tokens de integración en busca de abusos de repetición/alcance. A continuación, corrobore esta información con el registro (logging) automatizado del acceso a campos sensibles y las decisiones de políticas.

¿Cuál es la diferencia entre evitar la exposición de datos y evitar los flujos de trabajo analíticos legítimos?

Prevenir la exposición se trata de establecer por defecto vistas seguras (agregados, campos ocultos) y restringir la profundización/exportaciones de datos sensibles; prevenir flujos de trabajo consiste en un bloqueo generalizado que obliga a los usuarios a recurrir a soluciones alternativas (como las exportaciones).

¿Cómo puede la detección de anomalías de comportamiento distinguir entre un analista de datos que descubre información y una amenaza interna (insider threat) que extrae datos?

Establezca el comportamiento esperado (baseline) por rol y, a continuación, señale los cambios, como pasar de agregados a identificadores sin procesar, un alcance inusual en la unidad de negocio, la paginación rápida/bucles de exportación, o nuevos clientes accediendo a las APIs de consultas. Responda con controles de baja fricción (advertencias leves, reautenticación justo a tiempo, límites de frecuencia de exportación).

¿Qué impacto en la latencia o en el rendimiento de las consultas deben esperar las organizaciones al añadir controles de seguridad a los sistemas de análisis?

Si los controles son "silenciosos por defecto", el uso normal del panel de control sigue siendo rápido (caché de agregados, avisos mínimos), mientras que la fricción adicional se reserva para las acciones de mayor riesgo, como la profundización sensible y las exportaciones (autenticación reforzada, límites de alcance, registro).

¿El procesamiento de los análisis debería realizarse en una infraestructura local dedicada, aislada de los sistemas operativos?

Sí: trate los análisis como una zona segmentada: aísle el motor de consultas de las redes operativas, restrinja el tráfico este-oeste y dirija los datos regulados a grupos de procesamiento de mayor control.

¿Cómo entran en conflicto las estrategias de minimización de datos con la necesidad de tener conjuntos de datos analíticos completos?

Entran en conflicto cuando la minimización elimina el contexto necesario; resuelva esto diseñando modelos centrados primero en agregados (metric-first, cohortes/rangos) y permitiendo la profundización controlada solo cuando esté justificada y autorizada.

¿Qué papel deberían desempeñar los proveedores de análisis externos en las organizaciones que utilizan únicamente datos locales?

El acceso de proveedores debe ser la excepción: prefiera el análisis integrado dentro de su límite; si un proveedor debe conectarse, restrínjalo a una zona segmentada con credenciales de corta duración y alcance limitado, una estricta revisión del alcance de la API/rotación de claves y un registro completo.

¿Cómo miden las organizaciones si la seguridad de sus análisis es proporcional al riesgo real del negocio?

Alinee los controles con la intención y el riesgo (reforzando solo para las acciones de riesgo), valide los puntos de exposición reales (APIs/tokens/cachés/uniones) y garantice la "responsabilidad visible" mediante la captura automática de pruebas en lugar de la constante fricción para el usuario.

¿Cuál es la relación entre la precisión de la clasificación de datos y un control de acceso eficaz a los análisis?

La clasificación es la base: etiquete los campos durante la ingesta, transmita la sensibilidad a través del linaje/uniones, y utilice esas etiquetas para dirigir el procesamiento y renderizar lo que cada rol puede ver. Las etiquetas incorrectas significan una aplicación deficiente (enforcement).

¿Cómo pueden las organizaciones pronosticar y evitar la exposición de datos relacionada con los análisis antes de que ocurran incidentes?

Combine la evaluación continua de la exposición (probando las APIs de consultas, los tokens, las cachés y el comportamiento de las uniones) con la detección de anomalías basada en roles y pruebas de auditoría automáticas, para que los problemas salgan a la luz a tiempo sin interrumpir los análisis legítimos.